Verbessertes Gemini 2.5: Google rüstet den KI-Assistenten Gemini auf

Wie hätte es auch anders sein können: KI steht bei der Keynote von Googles Entwicklerkonferenz I/O 2025 im Mittelpunkt. Vor allem den Gemini-Assistenten rüstet man auf, viele Ankündigungen in den letzten Monaten starten nun und sind Teil eines überarbeiteten Abo-Pakets.

Beispielhaft steht dafür Gemini Live, die Screensharing-Funktion ist nun für sämtliche Android- und iOS-Nutzer freigeschaltet. Mit der Kamera- und Bildschirmfreigabe sind die KI-Assistenten in der Lage, das zu erfassen, was der Nutzer selbst sieht – und es direkt auszuwerten. Das soll die Bedienung insbesondere in Kombination mit dem Sprachmodus intuitiver machen.

Vorgestellt wurden diese bereits vor rund einem Jahr, vor allem OpenAIs GPT-4o-Präsentation sorgte damals für Aufsehen, Google zeigte entsprechende Funktionen aber auch bei der I/O 2024. Nach dieser Zeitspanne ist der Hype also ein Stück weit vorüber, nun startet aber der Live-Betrieb.

Neue Abo-Pläne: Gemini AI Pro und Ultra

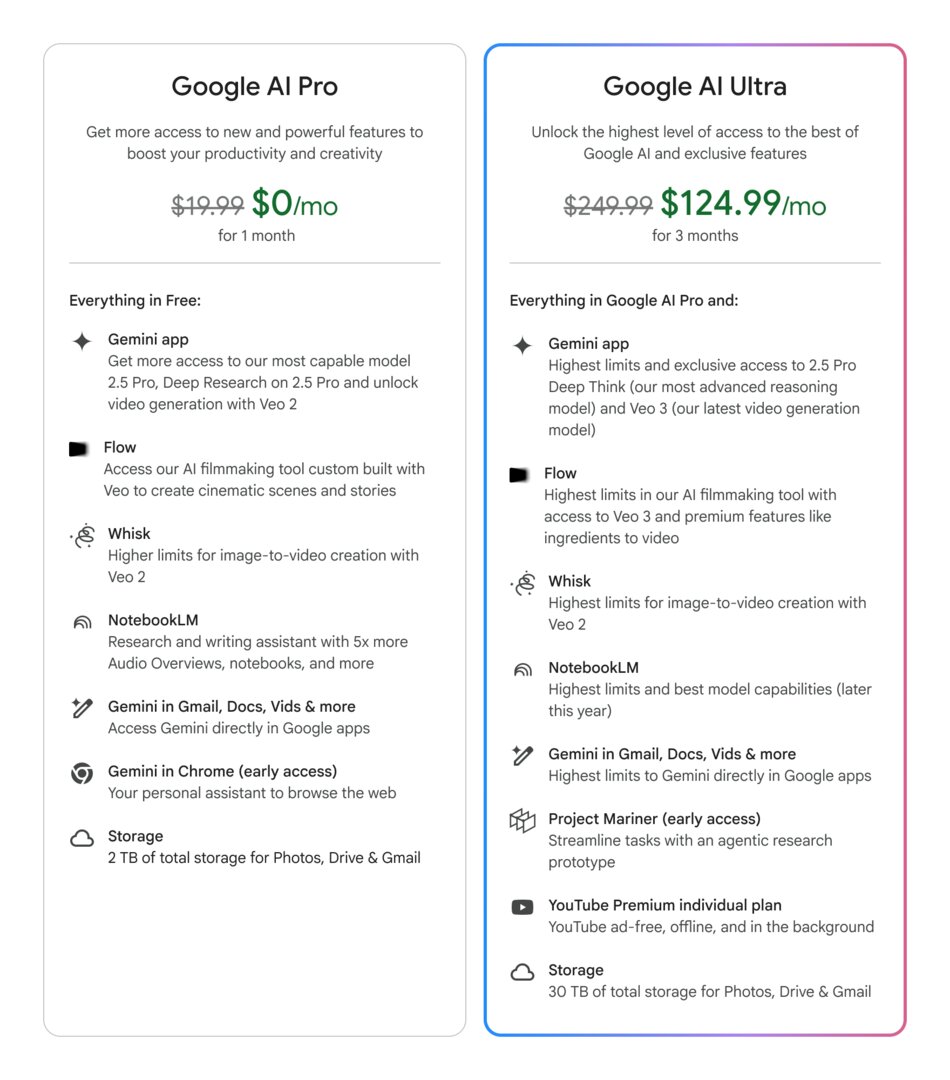

Welche Funktionen man nutzen kann, hängt vom Abonnement ab. Die Abo-Pakete hat Google überarbeitet. Gemini Advanced, bisher das kostenpflichtige Abo, wird zu Google AI Pro. Im Vergleich zur kostenfreien Gemini-Version erhalten Nutzer damit mehr Funktionen und höhere Limits bei den leistungsfähigen Modellen. Es kostet 19,99 US-Dollar monatlich.

Das neue Hochpreis-Abo ist hingegen Gemini AI Ultra. Nach der Anfangsphase kostet es 249 US-Dollar pro Monat, liegt also nochmal über dem, was OpenAI für ChatGPT Pro verlangt. Abonnenten erhalten damit den Zugang zu Spitzenmodellen wie Gemini 2.5 Thinking samt höherer Nutzungslimits, sämtliche Funktionen und können experimentelle Modelle wie das Project Manier testen – das umfasst die Computer-Nutzung-Funktion.

Google AI Ultra ist vorerst nur in den USA verfügbar. Weitere Länder sollen bald folgen.

Neue Bild- und Video-Modelle Imagen 4 und Veo 3

Zu den Neuerungen auf der I/O 2025 zählt zum einen die Bild-KI Imagen 4, die insbesondere Texte präziser darstellen soll. Zum anderen kann das Video-Modell Veo 3 nun neben Videos auch die dazu passenden Audio-Inhalte generieren. Diese sollen von Hintergrundgeräuschen in der Stadt bis zu richtigen Dialogen zwischen zwei Charakteren reichen – und Grundlage für solche Inhalte sind wie gehabt Text-Prompts.

Veo 3 ist vorerst begrenzt auf Google-AI-Ultra-Abonnenten in den USA.

Gemini direkt in Chrome abrufbar

Generell ist Google interessiert, dass der Gemini-Assistent im Alltag der Nutzer ankommt. Wie bereits durchsickerte, wird der KI-Assistent direkt in Chrome integriert. Google verteilt die Funktion ab heute sowohl unter Windows als auch macOS. Um den Zugang zu erhalten, benötigen Nutzer aber eines der kostenpflichtigen Abonnements.

Deep Research kann mit Dokumenten der Nutzer umgehen

Ein Upgrade erhält auch Googles Deep-Research-Tool, das – wie die Variante von ChatGPT (Test) – in der Lage ist, umfassende Berichte zu erstellen, die auf Dutzenden Quellen basieren. Um die Qualität zu verbessern, kann Gemini Deep Research nun ebenfalls mit Dokumenten umgehen, die Nutzer selbst hochladen. Das können sowohl PDFs als auch Bilder sein, die Inhalte werden dann mit öffentlich zugänglichen Informationen kombiniert.

Bald soll es zudem möglich sein, Deep Research direkt mit Google Drive und Gmail zu verbinden. Nutzer mit einem kostenpflichtigen Gemini-Abo können den Recherche-Assistenten mit dem aktuellen Gemini 2.5 Pro Experimental verwenden.

Gemini 2.5 Flash wird neues Standard-Modell

Grundlage für das Feature ist Gemini 2.5, das insbesondere auf Agenten-Aufgaben ausgelegt ist und auch über Reasoning-Fähigkeiten verfügt, die bei Google unter dem Namen „Thinking“ laufen. Das Spitzenmodell Gemini 2.5 Pro ist eines der bis dato in Benchmarks führenden Modelle, das mit Pro Deep Think eine überarbeitete Reasoning-Variante erhält. Gemini 2.5 Flash ist nun das neue Standard-Modell ist, das auf Effizienz optmiert ist.

- Gemini 2.5 Thinking: Googles neues KI-Modell setzt sich an die Spitze

- Gemini 2.5 Pro Experimental: Googles Deep Research soll ChatGPT übertreffen

- Google Cloud Next 2025: Gemini 2.5 Flash angekündigt, Veo 2 allgemein verfügbar

- Gemini 2.0 und Project Astra: Googles Startschuss für die Ära der KI-Agenten

Wesentliche Punkte von den I/O-Ankündigungen sind bereits bekannt, Google-CEO Sundar Pichai bestätigte das auch mit den ersten Sätzen auf der Keynote. Man will nicht – wie in den Vorjahren – auf die Entwicklerkonferenz warten, sondern Modelle zeitnah veröffentlichen. Was Google als Neuerungen präsentiert, sind daher eher kleinteilige Updates. Die Liste umfasst etwa eine über die Live-API abrufbare Preview-Version für den audio-visuellen Input, was beduetet: Das Modell ist in der Lage, realistischere Gespräche mit dem Nutzer zu führen. Ebenso lässt sich nun Googles Thinking-Modus über die Live-API abrufen. Gemini 2.5 und Flash erhalten zudem neue Preview-Versionen für den Text-zu-Sprache-Modus.

Computersteuerende KI-Modelle über API verfügbar

Über die Gemini-API und Vertex AI ist zudem auch Googles „Computer-use“-Modus verfügbar, mit dem das KI-System in der Lage ist, selbst einen Computer bei bestimmten Aufgaben in speziellen Umgebungen zu steuern. Wie gehabt handelt es sich um eine Vorab-Version. Unternehmen können diese nun testen, um das Potenzial eines solchen Agenten zu prüfen.

ComputerBase hat Informationen zu diesem Artikel von Google unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

- Google Stitch: KI-Tool zur Erstellung von UI-Designs vorgestellt

- Google im Auto: Volvo zeigt Gemini im EX90 und wird zur Referenzplattform

- Die KI-Suche übernimmt: Google startet den AI Mode für die Allgemeinheit

- +10 weitere News