Neue Bedienungshilfen für iOS 19: Apple kündigt Kopfsteuerung, Live-Untertitel und mehr an

iOS 19 ist noch nicht offiziell vorgestellt, doch wie üblich zeigt Apple bereits einen Monat vor der WWDC im Juni erste Neuheiten für iPhone, iPad und Mac: Dieses Jahr überarbeitet Apple viele bestehende Bedienungshilfen, fügt aber mit der Steuerung per Kopf, einer neuen Kameralupe für den Mac und der Braille auch neue hinzu.

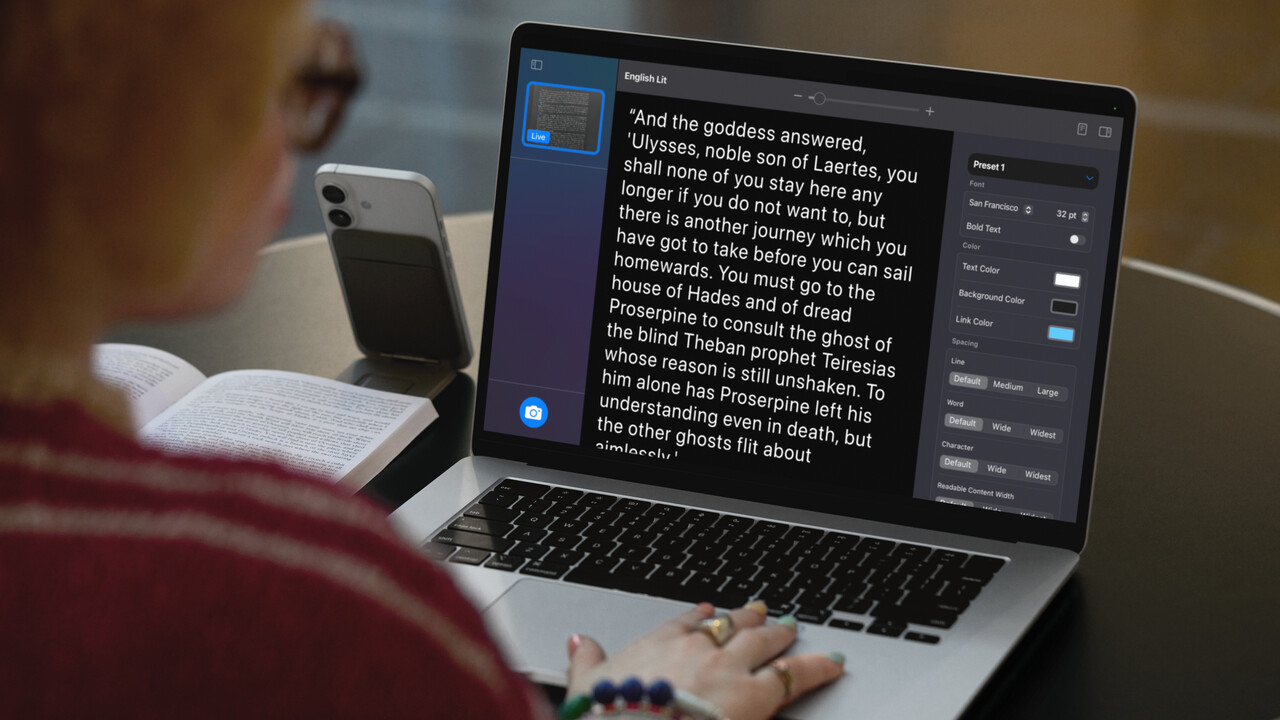

Lupe für Vorlesungen und Meetings am Mac

Mit einer neuen Kameralupe möchte Apple die seit 2016 vorhandene Lupe im iPhone und iPad auch auf den Mac bringen. Dafür verbindet der Nutzer einfach eine Kamera oder ein iPhone bzw. iPad und kann sodann die Kamera als Lupe in Vorlesungen oder Meetings verwenden. Per Foto-Funktion lassen sich so in Echtzeit Folien festhalten und gleich bearbeiten.

Live-Untertitel auf der Apple Watch

Mit „Live Mithören“ hat Apple schon vor längerer Zeit die Möglichkeit geschaffen, Gespräche um den Nutzer herum zu verstärken und anzupassen. Mit iOS 19 transkribiert das Betriebssystem die Gespräche in Echtzeit und überträgt den Text auf Wunsch auf eine gekoppelte Apple Watch. Die Funktion ist mit den Hörhilfen der AirPods Pro 2 kompatibel.

Die Live-Untertitel könnten zudem einen Schritt in Richtung der Live-Übersetzungen darstellen, die Apple angeblich für iOS 19 vorbereiten soll.

Weitere neue Funktionen

Informationen zur Barrierefreiheit von Drittanbieter-Apps gibt es in Zukunft auch prominenter im App Store, denn dort findet sich in Zukunft eine Übersicht der unterstützten Funktionen einer jeden App.

Neben der letztes Jahr eingeführten Augensteuerung lassen sich iPhone und iPad nun auch mit einer Kopfsteuerung bedienen.

Zudem wird mit iOS 19 ein neuer Reader eingeführt, der PDFs, aber auch Webseiten für Leser mit eingeschränktem Sehvermögen, dank anpassbarer Schriftgröße, Hintergrund, Abstände und Vorlesemodus einfacher zugänglich machen soll.

Bedienungshilfen lassen sich mit dem Update sogar teilen, Einstellungen lassen sich damit schnell auf ein neues Gerät übertragen, wenn dieses ausgeliehen wird, wie Apple als Beispiel skizziert.

Verbesserungen bestehender Hilfen

Neben neuen Funktionen überarbeitet Apple auch eine große Anzahl an bestehenden. So überarbeitet der Konzern etwa die Funktion, seine eigene Stimme digital über das iPhone nachzubilden: Anstelle von 150 Sätzen benötigt die KI im Hintergrund nur noch zehn Sätze, um eine „flüssigere, natürlichere“ Stimme zu erzeugen.

Wer zeitweise unter Reisekrankheit im Zug, Auto oder Flieger leidet, kann nun erstmals mit macOS 16 am Mac auf fliegende Punkte zur Linderung der Symptome zugreifen. Die Punkte mindern Übelkeits- oder Schwindelgefühle, da sie die Bewegung des Fortbewegungsmittels ausgleichen. Auf allen drei Plattformen können diese jetzt zudem angepasst werden.

- Hintergrundgeräusche lassen sich jetzt automatisieren und die Töne durch einen EQ besser abstimmen.

- Die Augensteuerung oder auch Blickfassung wird durch Timer und bessere Indikatoren erweitert, das soll unter anderem die Nutzung der Tastatur verbessern.

- Bei der Musikhaptik lassen sich Vibrationen nur für Gesang oder den ganzen Song aktivieren.

- Die Geräuscherkennung unterstützt jetzt auch bestimmte Wörter und Namen, erkennt also, wenn eine Person gerufen wird.

- Die Sprachsteuerung wird auf XCode ausgeweitet, Programmierer sollen dann in der Lage sein per Sprache Anwendungen zu entwickeln.