Jetson Thor: Nvidias Roboter-Gehirn auf Blackwell-Basis ist fertig

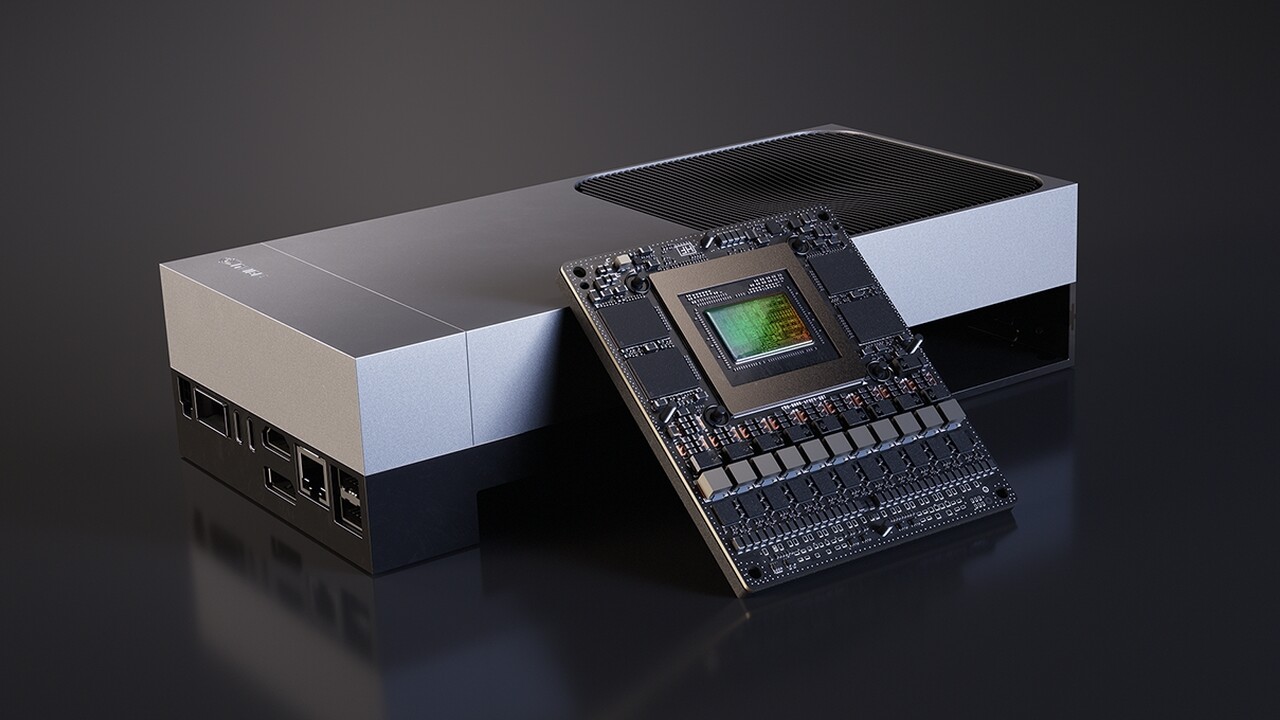

Nvidias nächste Generation „Roboter-Gehirn“ ist mit Jetson Thor auf Blackwell-Basis ab sofort in zwei Ausführungen in großer Stückzahl verfügbar. Entwickler können zudem das Jetson AGX Thor Developer Kit bestellen. Die neue Plattform macht einen deutlichen Sprung für mehr KI-Leistung und die Unterstützung multipler Sensoren.

Die Robotik-Plattform Jetson vollzieht mit der Neuauflage den Wechsel von Ampere (Orin) zu Blackwell (Thor). Nvidia hatte Jetson Thor Anfang des Jahres rudimentär angekündigt, jetzt ist die Robotik-Plattform aber in großer Stückzahl verfügbar und kann bestellt werden. Dabei bietet Nvidia das Produktionsmodul, also das Herzstück eines Roboters, um das Abnehmer ihr Produkt bauen, als Jetson Thor T5000 und T4000 an. Jetson Thor T5000 mit 2.070 TFLOPS kostet 2.999 US-Dollar pro Einheit bei der Abnahme von 1.000 Stück, die Variante T4000 mit 1.200 TFLOPS liegt bei 1.999 US-Dollar.

Entwicklerkit kostet 3.499 US-Dollar

Das Produktionsmodul kommt „nackt“, Entwickler von Robotern müssen sich somit nach individuellen Anforderungen um die Kühlung, Verkabelung und das Chassis drumherum kümmern. Nvidia liefert ausschließlich das Roboter-Gehirn, unterstützt Unternehmen aber mit Blaupausen und SDKs bei der Entwicklung. Direkt einsatzbereit ist hingegen das Jetson AGX Thor Developer Kit, das auf dem großen Thor T5000 basiert, an das Unternehmen „nur noch“ ihre Sensoren und Aktuatoren anschließen müssen. Das Entwicklerkit kostet 3.499 US-Dollar vor Steuern. Die günstigeren Orin- und Xavier-Lösungen bleiben im Sortiment.

Mehr KI-Leistung und Speicher für Generative AI

Unterschiede zwischen Jetson Thor T5000 und T4000 sind in erster Linie in der KI-Leistung, der GPU und CPU, dem Speicher und dem Energieverbrauch zu finden (Tabelle am Ende des Artikels). Bei der KI-Leistung liefert die größere Lösung 2.070 statt 1.200 TFLOPS (NVFP4, Sparse), abgeleitet von einer Blackwell-GPU mit 2.560 statt 1.536 CUDA Cores. Die Arm-CPU mit Neoverse-V3AE-Kernen reduziert Nvidia von 14 auf 12 Kerne, der Speicher wird von 128 auf 64 GB halbiert. Diese Maßnahmen resultieren in einem konfigurierbaren Energiebedarf von 40 bis 75 Watt statt 40 bis 130 Watt.

Jetson Thor soll mit der gesteigerten KI-Leistung, mehr Speicher, mehr unterstützten Sensoren und schnellerem Netzwerk von jetzt 25 Gbit/s den Anforderungen moderner Roboter gerecht werden. Intelligente Echtzeit-Interaktionen mit Menschen in der physischen Welt sollen mit Jetson Thor möglich sein.

Im Vergleich zum direkten Vorgänger Jetson Orin gibt Nvidia eine bis zu 7,5-fache KI-Leistung an: 2.070 TFLOPS (NVFP4) vs. 275 TOPS (INT8). Aufseiten der CPU sollen die bis zu 14 Neoverse-V3AE-Kerne die 3,1-fache Leistung im Vergleich zur vorherigen 12-Core-Lösung mit Cortex-A78AE liefern. Der RAM fällt mit maximal 128 GB neuerdings doppelt so groß aus, was lokal ausgeführte aktuelle KI-Modelle im Bereich der Generative AI beschleunigen soll. Nvidia bietet aus der Familie Isaac GR00T N Robot auch selbst eine Reihe von Foundation Models an.

Lösungen für alle Bereiche der Robotik

Nvidia selbst baut keine Roboter, es stellt ausschließlich die Hardware-Plattform und Software für die Umsetzung. Auf den Robotik-Stack des Unternehmens setzen derzeit über 2,2 Millionen Entwickler und mehr als 7.000 Unternehmen, heißt es in der heutigen Ankündigung. Zu den ersten Abnehmern von Jetson Thor zählen Agility Robotics, Amazon Robotics, Boston Dynamics, Caterpillar, Figure, Hexagon, Medtronic und Meta.

Jetson Thor ist ein Glied in der Kette von dem, was Nvidia als „Physical AI“ bezeichnet, also KI, die von Robotern in der physischen Welt und nicht nur auf Computern ausgeführt wird. Den Bereich der Robotik unterteilt Nvidia dabei in drei Säulen, und für alle drei habe man die passenden Lösungen: Nvidia DGX für das Training, Nvidia Omniverse mit Cosmos für die Simulation und Nvidia Jetson für den Einsatz in der physischen Welt.

Roboter gibt es nach Ansicht von Nvidia grob unterteilt in drei Ausführungen: Klassische „Roboter-Roboter“, also humanoide Roboter, wie man sie am ehesten aus Science-Fiction-Filmen kennt. In diese Kategorie fallen aber auch Roboterarme in Fabriken. Weitere Roboter sind autonome Maschinen und autonome Fahrzeuge.

Entwicklerkit des Drive AGX Thor verfügbar

Für letztere Kategorie der autonomen Fahrzeuge bietet Nvidia mit Drive Thor eine passende Hard- und Software-Lösung an. Auch für diese Plattform stellt Nvidia mit dem neuen Drive AGX Thor Developer Kit fortan eine Lösung für Entwickler bereit, die sich ab sofort vorbestellen lässt und die im September ausgeliefert werden soll.

| Jetson AGX Thor Developer Kit | Jetson Thor T5000 | Jetson Thor T4000 | |

|---|---|---|---|

| KI-Leistung | 2.070 TFLOPS (NVFP4, Sparse) | 1.200 TFLOPS (NVFP4, Sparse) | |

| GPU | Nvidia Blackwell, 2.560 CUDA Cores, 96 Tensor Cores, Multi-Instance GPU mit 10 TPCs | Nvidia Blackwell, 1.536 CUDA Cores, 64 Tensor Cores, Multi-Instance GPU mit 6 TPCs | |

| GPU-Takt | 1,57 GHz | ||

| CPU | 14 × Arm Neoverse-V3AE, 1 MB L2 pro Core, 16 MB, Shared System L3 Cache | 12 × Arm Neoverse-V3AE, 1 MB L2 pro Core, 16 MB, Shared System L3 Cache | |

| CPU-Takt | 2,6 GHz | ||

| Vision Accelerator | 1 × PVA v3 | ||

| Memory | 128 GB 256-Bit LPDDR5X, 273 GB/s | 64 GB 256-Bit LPDDR5X, 273 GB/s | |

| Storage | 1 TB NVMe M.2 | Unterstützt NVMe über PCIe, SSD über USB 3.2 | |

| Video Encode | 6 × 4K60 (H.265), 12 × 4K30 (H.265), 24 × 1080p60 (H.265), 50 × 1080p30 (H.265), 48 × 1080p30 (H.264), 6 × 4K60 (H.264) | ||

| Video Decode | 4 × 8K30 (H.265), 10 × 4K60 (H.265), 22 × 4K30 (H.265), 46 × 1080p60 (H.265), 92 × 1080p30 (H.265), 82 × 1080p30 (H.264), 4 × 4K60 (H.264) | ||

| Kamera | HSB-Kamera via QSFP-Slot, USB-Kamera | Bis zu 20 HSB-Kamera, bis zu 6 Kameras via 16x Lanes MIPI CSI-2, bis zu 32 Kameras über virtuelle Kanäle, C-PHY 2.1, D-PHY 2.1 | |

| PCIe | M.2 PCIe Gen 5 x4, M.2 PCIe Gen 5 x1 | Bis zu Gen 5 x8, Root Port C1 (x1) und C3 (x2), Root Point oder Endpoint C2 (x1), C4 (x8), C5 (x4) | |

| Netzwerk | 1 × 5 Gbit/s RJ45, 1 × QSFP28 (4 × 25 Gbit/s) | 4 × 25 Gbit/s | 3 × 25 Gbit/s |

| Display | 1 × HDMI 2.0b, 1 × DisplayPort 1.4a | 4 × Shared HDMI 2.1, 1 × DisplayPort1.4a | |

| Weitere I/O | QSFP Connector, M.2 (WLAN/BT, x1 PCIe, USB 2.0, UART, I2C, I2S), M.2 (NVMe für Storage), PCIe x4, I2C, PCIe x2, 2 × 13-Pin CAN Header, 2 × 6-Pin Automation Header, LED, JTAG Connector (2 × 5-Pin Header), 1 × Fan Connector (12 V, PWM, Tach), Audio Panel Header (2 × 5-Pin), Microfit Power Jack, RTC Backup Battery Connector 2-Pin | 5 × I2S/2 × Audio Hub (AHUB), 2 × DMIS, 4 × UART, 4 × CAN, 3 × SPI, 13 × I2C, 6 × PWM Outputs | 5 × I2S/2 × Audio Hub (AHUB), 2 × DMIS, 4 × UART, 3 × SPI, 13 × I2C, 6 × PWM Outputs |

| Power | 40 – 130 Watt | 40 – 75 Watt | |

| Größe | 243,19 × 112,40 × 56,88 mm | 100 × 87 mm | |

ComputerBase hat Informationen zu diesem Artikel von Nvidia unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.