Nvidias CPX-Chip: Für Rubin gestrichen, bei Feynman eventuell wieder da

Schon zur Keynote am Montag vermisste die ComputerBase-Redaktion den Rubin-CPX-Chip. Von Ian Buck, VP & General Manager, Hyperscale und HPC bei Nvidia, erhielt die Redaktion nun eine Antwort, warum er denn von der Roadmap verschwunden ist. Demnach sei die Idee erst einmal auf das Wartegleis geschoben worden.

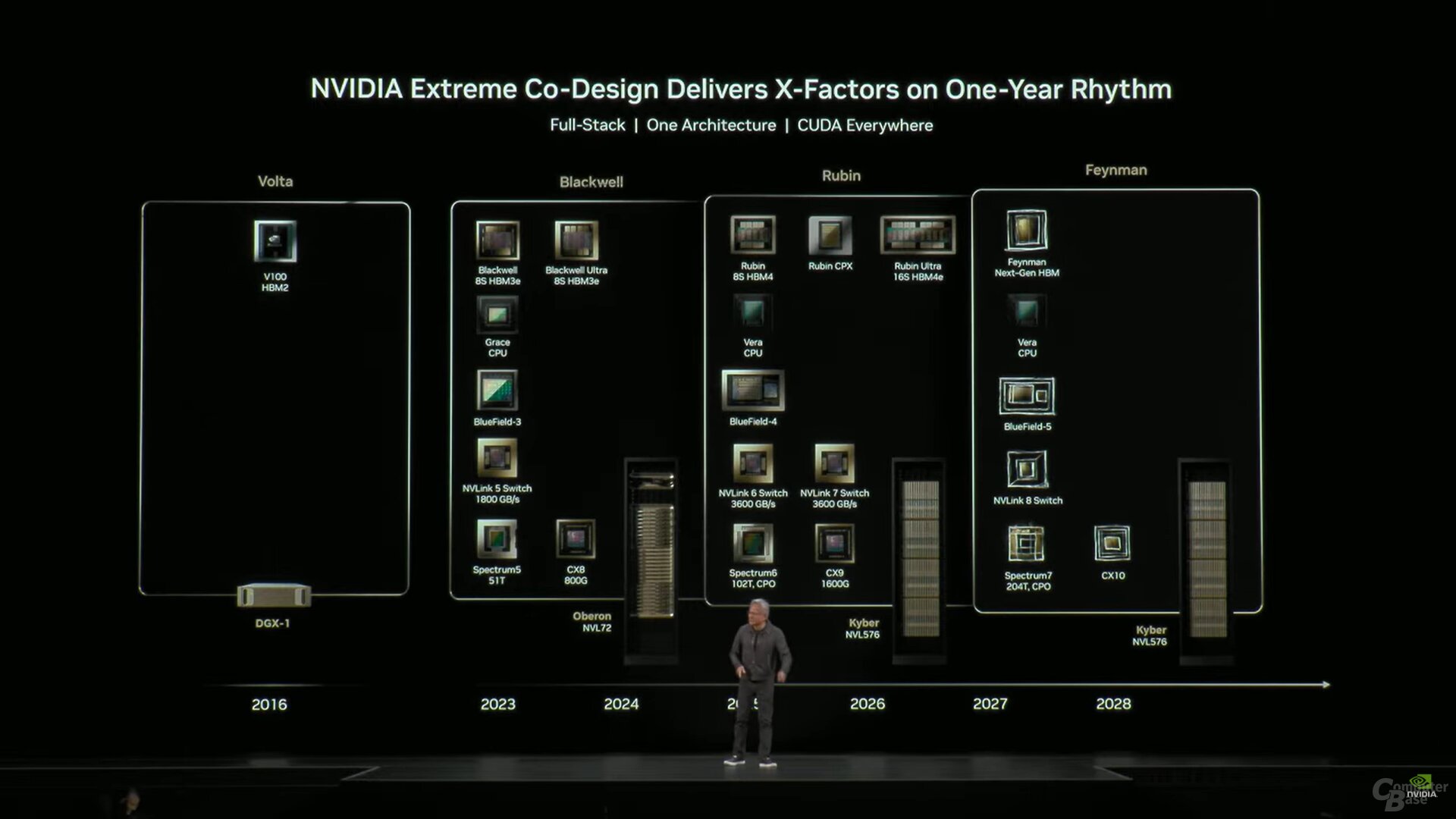

Erst vor einem guten halben Jahr hatte Nvidia den Chip überhaupt enthüllt. Nvidia Rubin CPX mit GDDR7 war auf brachiale Rohleistung für einen hohen Inferencing-Durchsatz ausgelegt, vor allem für den FP4-Bereich. Passend dazu war die Lösung dann auch auf Nvidias Roadmaps vertreten. Zur Eröffnungskeynote der GTC 2026 am Montag war von Rubin CPX aber auf der Roadmap nichts mehr zu sehen.

In einem Roundtable mit Ian Buck, so etwas wie die Nummer Zwei im Konzern, bestätigte der Manager, dass Rubin CPX nicht kommen wird. Die Idee sei aber nicht tot, eventuell wird sie schon bei Feynman, also der nächsten Chip-Generation, wieder zum Leben erweckt.

Denn der Chip hatte auch seine Stärken, beim Prefill hätte diese Lösung durchaus geholfen, nicht aber bei der eigentlichen Token-Ausgabe. Der Fokus ist nun kurzfristig erst einmal auf die schnelle Token-Generierung gewechselt, und dafür sei das zur GTC 2026 enthüllte LPX-Rack mit den neuen Nvidia Groq 3 LPU besser geeignet. Zu viele Chips zeitgleich zu realisieren und sinnvoll unterzubringen sei kurzfristig jedoch nicht möglich, führte Buck weiter aus.

Die LPU übernimmt (zum Teil)

Für die bei Inference wichtige, sehr schnelle Token-Generierung für Echtzeit-KI-Anwendungen setzt Nvidia nun also auf Groqs Language Processing Unit (LPU). Diese nutzt eine deterministische Architektur ohne Caches, Branch-Prediction oder dynamisches Scheduling. Weil der Compiler jede Operation und jeden Datenfluss im Voraus plant, entstehen exakt vorhersehbare Laufzeiten. Das Ergebnis ist ein Inference-Beschleuniger mit konstanter und sehr niedriger Latenz. Für sehr kurze Zugriffszeiten und eine hohe Bandbreite sorgt dabei auch ein 500 MB großer On-Chip-SRAM.

Statt den CPX-Chip aber wie ursprünglich einmal geplant noch in dem regulären NVL72-Rack unterzubringen, werden die LPUs in einem separaten Rack daneben gestellt. Am Ende soll das Gesamtpaket so ein breiteres Spektrum des Marktes mit effizienten Lösungen für ihre Probleme abdecken.

ComputerBase hat Informationen zu diesem Artikel von Nvidia im Rahmen einer Veranstaltung des Herstellers in San Jose, Kalifornien erhalten. Die Kosten für An-, Abreise und fünf Hotelübernachtungen wurden vom Unternehmen getragen. Eine Einflussnahme des Herstellers oder eine Verpflichtung zur Berichterstattung bestand nicht.

- Nvidias CPX-Chip: Für Rubin gestrichen, bei Feynman eventuell wieder da

- CB-Funk-Podcast #161: Nvidia DLSS 5 und alles zur Technik von Crimson Desert

- AI-Beschleuniger nach China: Nvidia hat Bestellungen und Lizenzen für H200-Exporte

- +17 weitere News